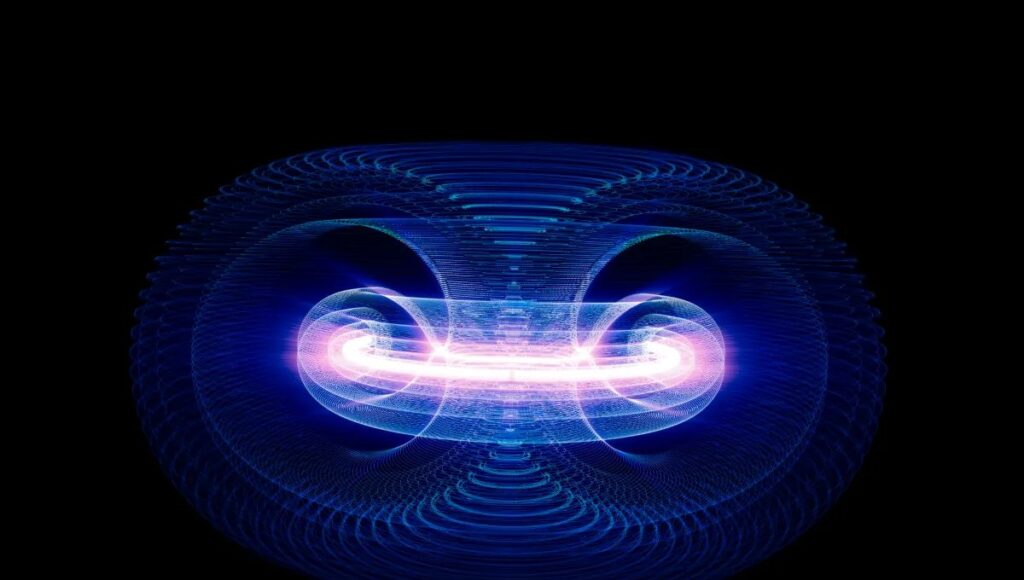

Washington (EUA) – Um grupo bipartidário formado por cientistas, ex-autoridades e personalidades públicas publicou, nesta primeira semana de março, a “Declaração Pró-Humana”, documento que descreve um conjunto de princípios para o avanço responsável da inteligência artificial. O texto surge dias após o impasse entre o Departamento de Defesa dos Estados Unidos e a Anthropic, evidenciando a ausência de normas claras para o setor.

Dois caminhos possíveis

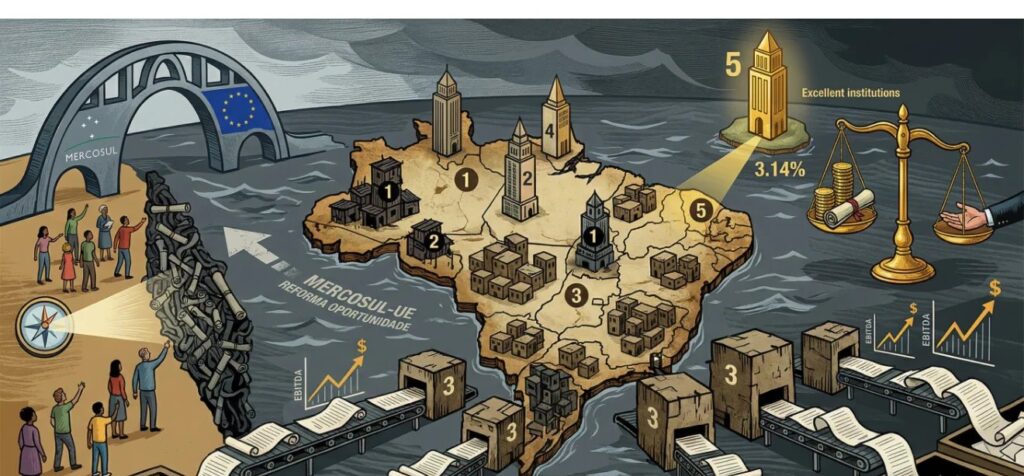

A declaração afirma que a humanidade enfrenta uma encruzilhada: um “polo de substituição”, em que máquinas assumem postos de trabalho e decisões, concentrando poder em instituições opacas; e um “polo de expansão”, no qual a IA amplia as capacidades humanas. Para garantir o segundo cenário, os signatários defendem cinco pilares:

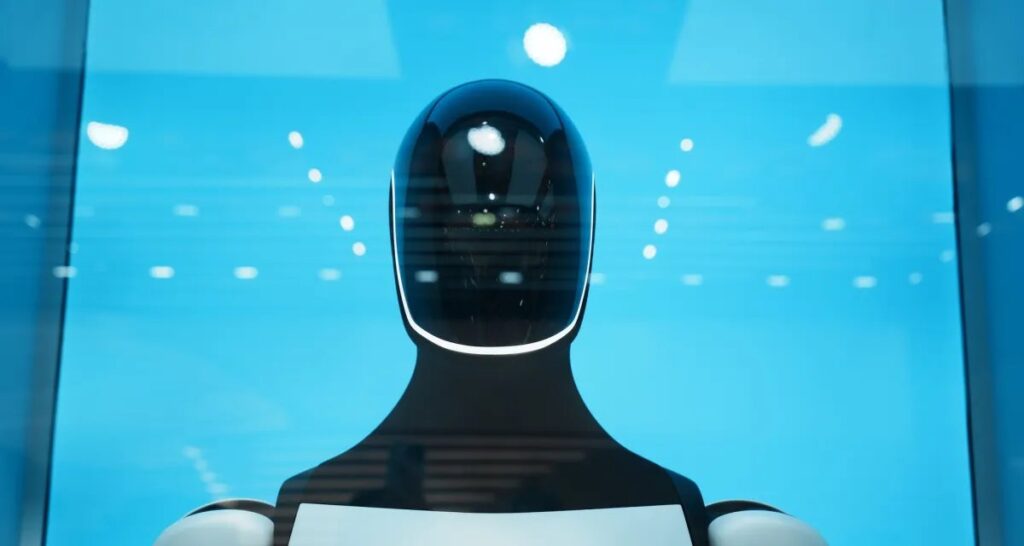

- manter o controle humano sobre os sistemas;

- evitar concentração de poder;

- proteger a experiência humana;

- preservar liberdades individuais;

- responsabilizar juridicamente as empresas de IA.

Entre as medidas propostas estão a proibição de pesquisas que visem à superinteligência até haver consenso científico sobre segurança e aval democrático, a exigência de botões de desligamento em modelos avançados e o veto a arquiteturas capazes de auto-replicação, autoaperfeiçoamento autônomo ou resistência a desligamento.

Crise com o Pentágono acelera debate

O lançamento do documento coincide com o episódio de 28 de fevereiro, quando o secretário de Defesa, Pete Hegseth, classificou a Anthropic como “risco à cadeia de suprimentos” após a empresa negar acesso ilimitado de suas ferramentas ao Pentágono – rótulo normalmente reservado a companhias com vínculos chineses. Horas depois, a OpenAI fechou acordo próprio com a pasta, que especialistas dizem ser difícil de fiscalizar. Os dois eventos, segundo os articuladores da declaração, expõem o custo da inação do Congresso.

Segurança infantil como ponto de pressão

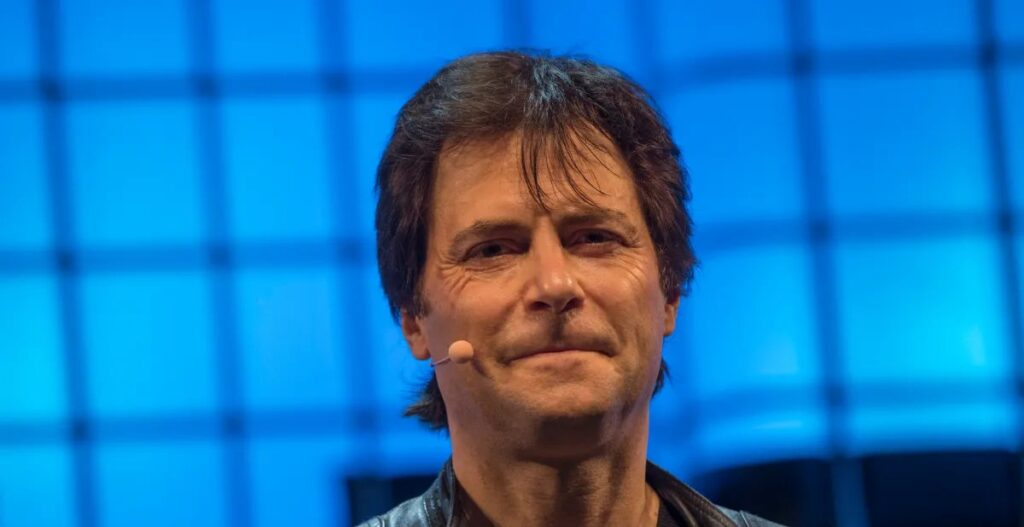

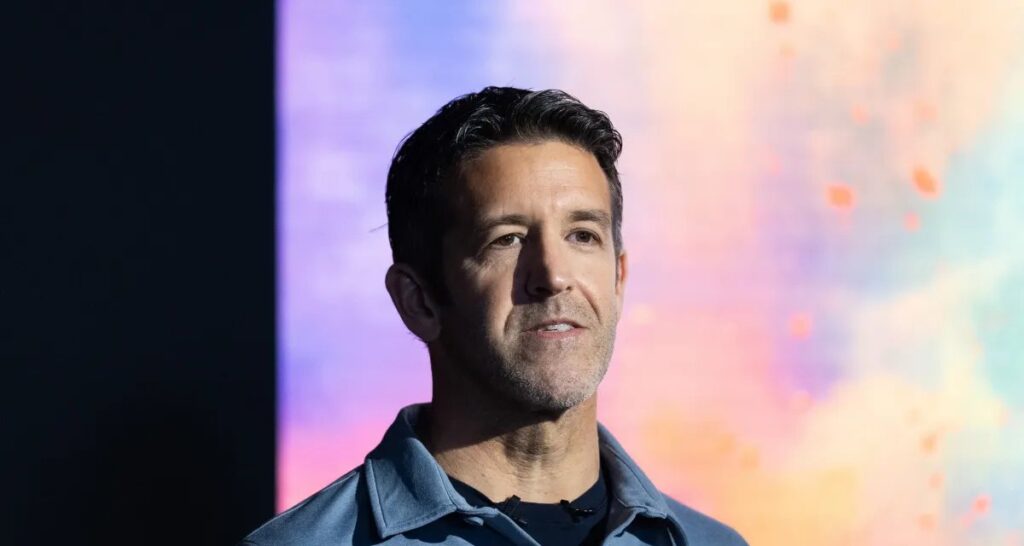

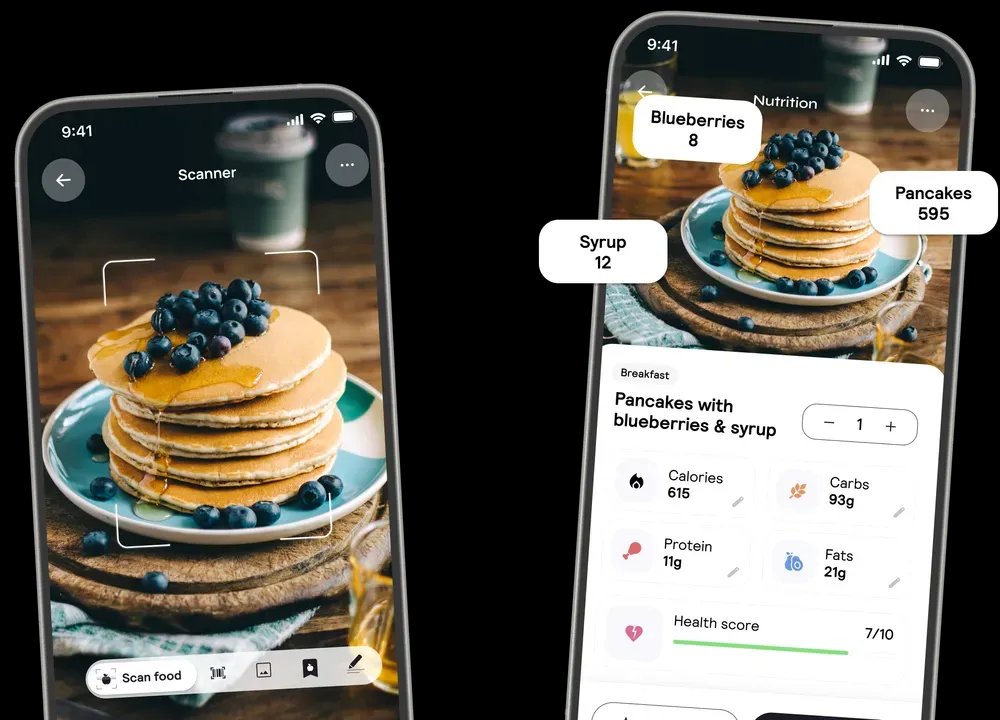

Max Tegmark, físico do MIT e um dos organizadores, diz que a proteção de crianças pode destravar a criação de regras. O texto exige testes obrigatórios antes da liberação de produtos voltados a menores – como chatbots e aplicativos de companhia – para avaliar riscos de ideação suicida, agravo de problemas mentais e manipulação emocional.

“Se um adulto finge ser uma criança de 11 anos para induzir outra ao suicídio, ele vai preso. Por que seria diferente se for uma máquina?”, questionou Tegmark.

Ele avalia que, a partir dessa exigência, outras serão adicionadas, como verificar se sistemas podem auxiliar terroristas em armas biológicas ou desenvolver capacidades que ameacem a segurança nacional.

Imagem: Getty

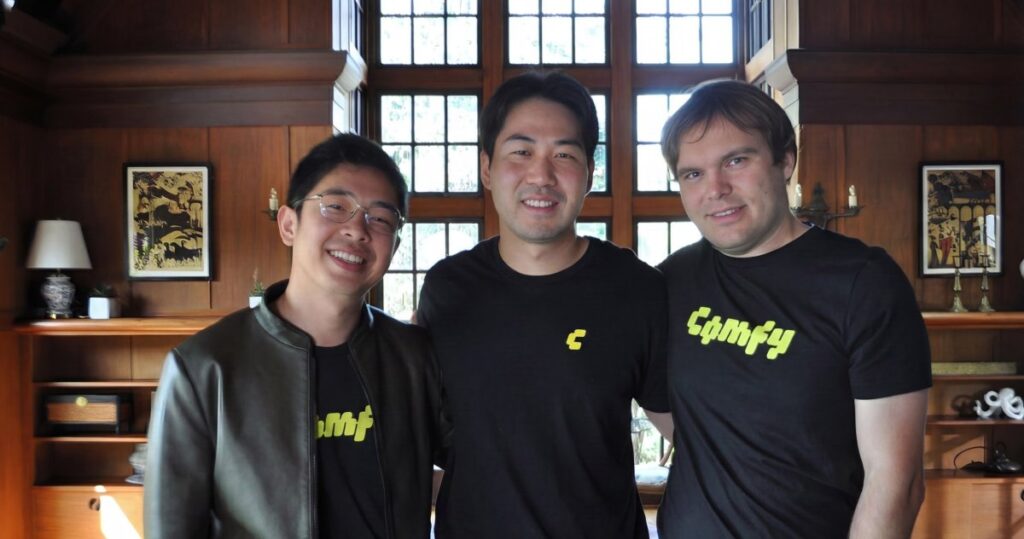

Alinhamento raro

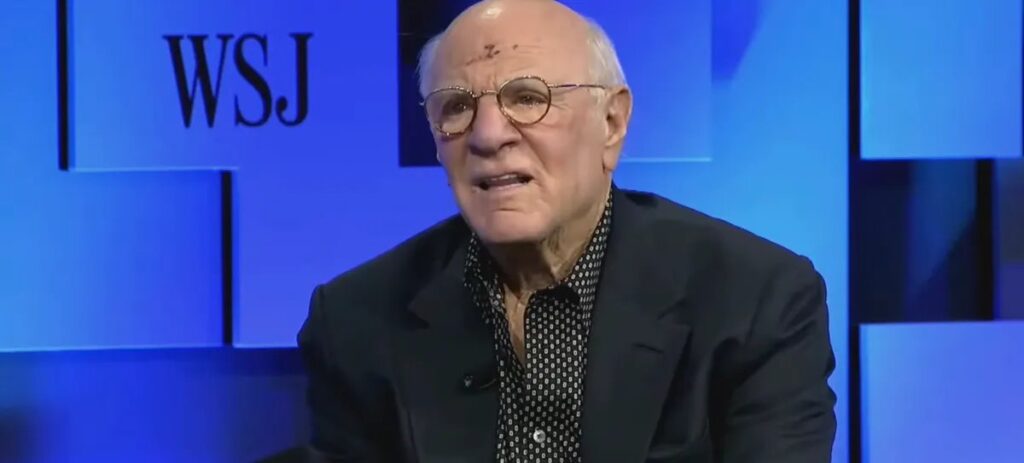

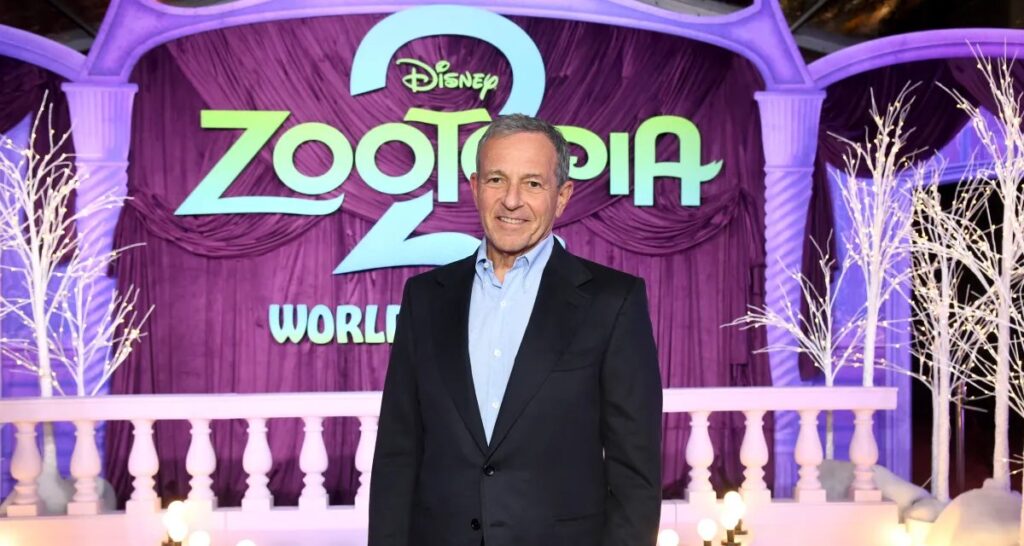

A lista de apoiadores reúne figuras de espectros opostos, entre elas o ex-estrategista de Donald Trump, Steve Bannon, a ex-conselheira de segurança nacional de Barack Obama, Susan Rice, o ex-chefe do Estado-Maior Conjunto Mike Mullen e líderes religiosos progressistas. “Quando a escolha é entre um futuro para humanos ou para máquinas, todos ficam do mesmo lado”, resumiu Tegmark.

Até o momento, centenas de especialistas e ex-funcionários assinaram o documento, que busca preencher o vácuo regulatório apontado por pesquisas recentes: 95% dos norte-americanos seriam contrários a uma corrida desregulada rumo à superinteligência.

Não há previsão de quando – ou se – o Congresso adotará as recomendações, mas os organizadores esperam que a convergência política sem precedentes pressione o Legislativo a agir.

Com informações de TechCrunch