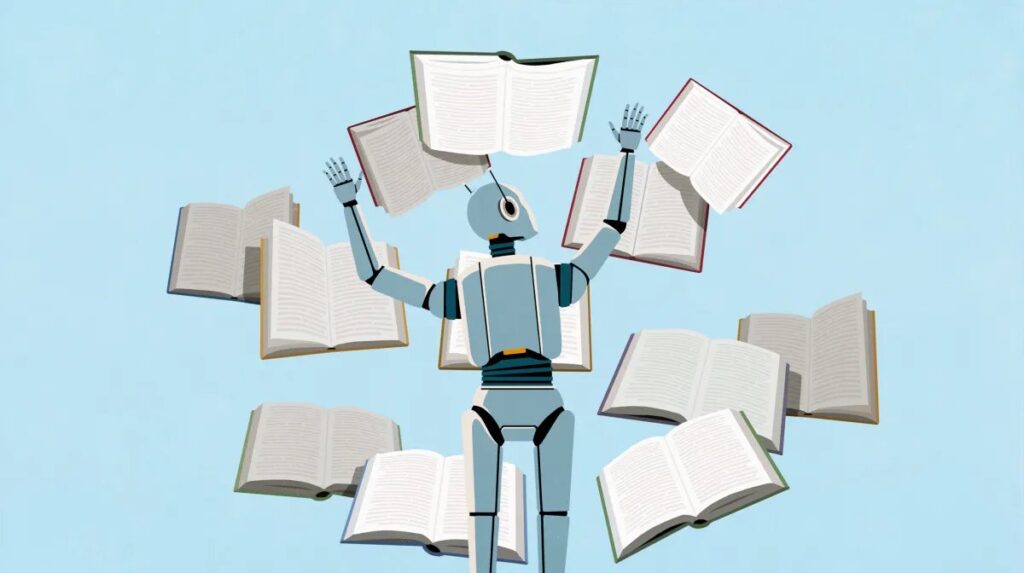

A TechCrunch lançou em 12 de abril de 2026 um glossário que explica, em linguagem acessível, os termos mais utilizados na indústria de inteligência artificial (IA). O material reúne conceitos que aparecem com frequência nas reportagens do veículo e será atualizado periodicamente para acompanhar a evolução da área.

Principais definições incluídas

Entre as expressões descritas, estão:

- AGI (Inteligência Geral Artificial) – sistemas capazes de executar a maioria das tarefas cognitivas em nível humano, definição que varia entre laboratórios como OpenAI e Google DeepMind.

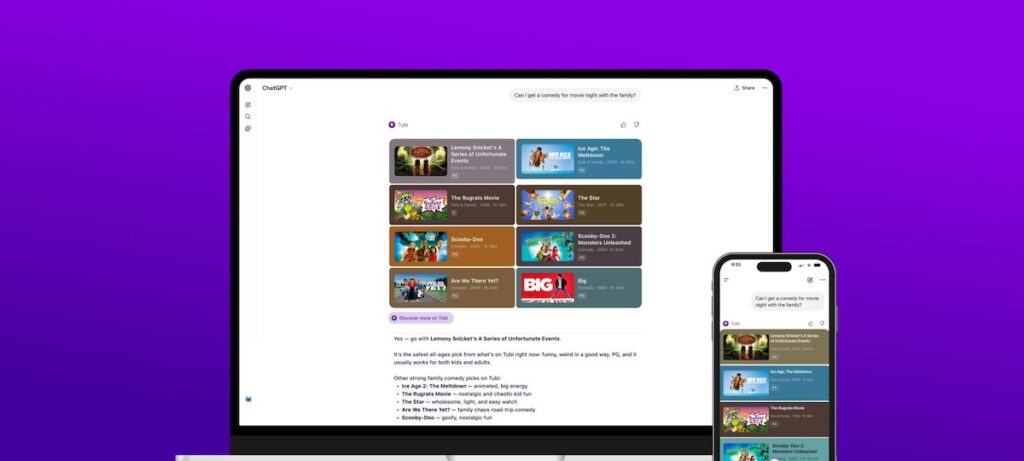

- Agente de IA – ferramenta autônoma que realiza múltiplas etapas, como reservar viagens ou escrever código, combinando diversos modelos.

- Chain-of-thought – método que divide um problema em etapas intermediárias para melhorar precisão de respostas em modelos de linguagem.

- Compute – poder de processamento (GPUs, CPUs, TPUs) necessário para treinar e operar modelos.

- Deep learning – subsetor do aprendizado de máquina baseado em redes neurais de múltiplas camadas que extraem características dos dados sem intervenção humana.

- Diffusion – técnica que adiciona ruído a dados para, depois, aprender a reverter o processo e gerar imagens, músicas ou textos.

- Distilação – processo de treinar um modelo menor (estudante) a partir das saídas de um modelo maior (professor) para ganhar velocidade e eficiência.

- Fine-tuning – ajuste adicional de um modelo já treinado com dados específicos para uma tarefa ou setor.

- GAN – redes adversárias geradoras que usam dois modelos (gerador e discriminador) em competição para produzir conteúdo realista.

- Alucinação – quando o modelo inventa informações incorretas por lacunas nos dados de treinamento.

- Inferência – fase em que o modelo, já treinado, gera previsões ou respostas usando hardware variado.

- LLM – grandes modelos de linguagem que alimentam assistentes como ChatGPT, Claude, Gemini e Llama.

- Cache de memória – otimização para acelerar a inferência, reduzindo cálculos repetidos, como no KV cache.

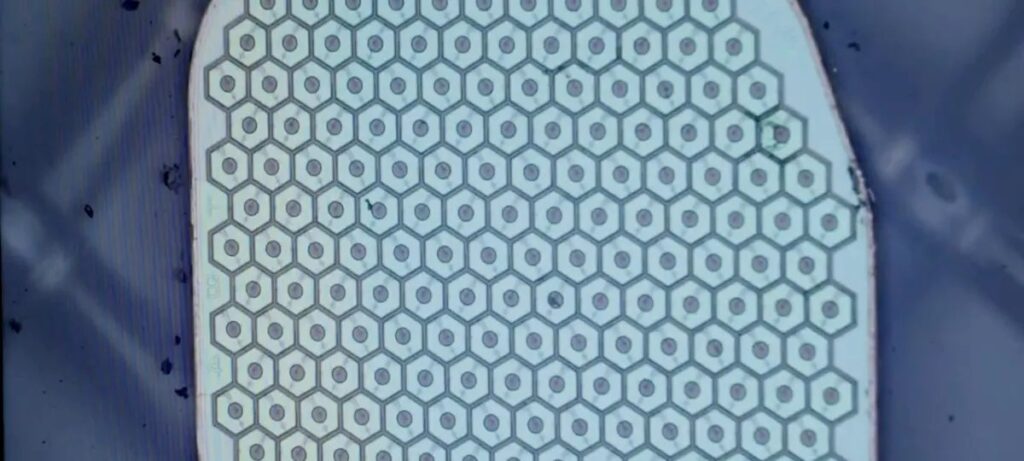

- Rede neural – estrutura algorítmica inspirada no cérebro humano, base do deep learning.

- “RAMageddon” – falta global de memória RAM provocada pela demanda crescente de data centers de IA.

- Treinamento – processo de alimentar dados ao modelo para que ele aprenda padrões e gere saídas.

- Tokens – unidades em que textos são divididos para entrada e saída de modelos; servem também para precificação de serviços.

- Transfer learning – uso de um modelo pré-treinado como ponto de partida para uma nova tarefa relacionada.

- Pesos – parâmetros numéricos que indicam a importância de cada característica no resultado produzido pelo modelo.

O glossário abrange ainda a relação entre custo de computação, segurança e riscos de desinformação gerados pelas alucinações, além de apontar a tendência do mercado em adotar modelos mais especializados para reduzir erros.

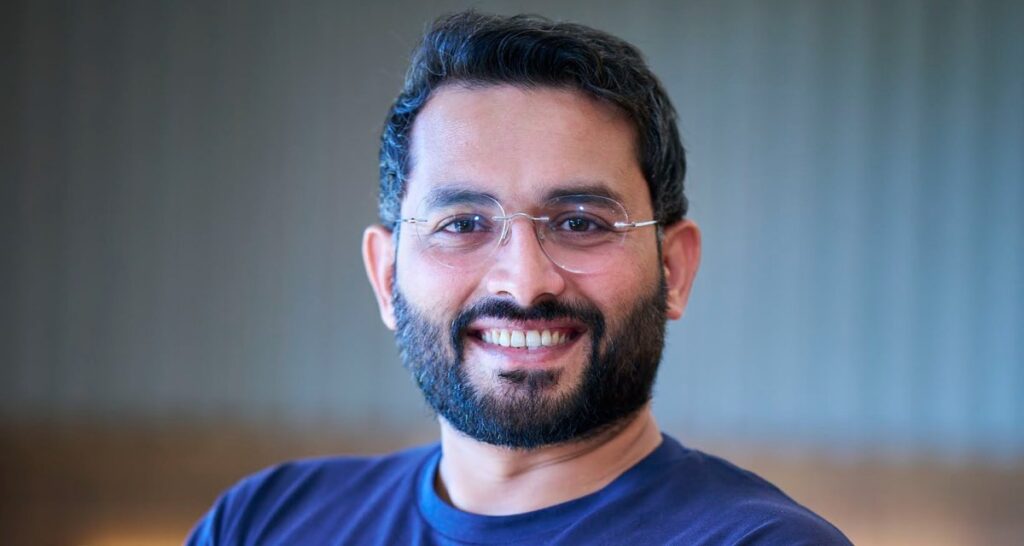

A publicação é assinada pelos jornalistas Natasha Lomas, Romain Dillet, Kyle Wiggers e Lucas Ropek, responsáveis pela cobertura de IA no site. Segundo o TechCrunch, novos verbetes serão acrescentados conforme surgirem tecnologias e desafios.

Imagem: Getty

Com informações de TechCrunch