São Francisco, 6 de outubro de 2025 – A Deloitte anunciou nesta segunda-feira um acordo de abrangência mundial com a Anthropic para disponibilizar o chatbot Claude a quase 500 mil funcionários e desenvolver soluções de conformidade para setores regulados. A declaração ocorreu no mesmo dia em que veio a público que a consultoria terá de reembolsar parte de um contrato com o governo australiano devido a informações incorretas produzidas por inteligência artificial.

Implantação interna de Claude

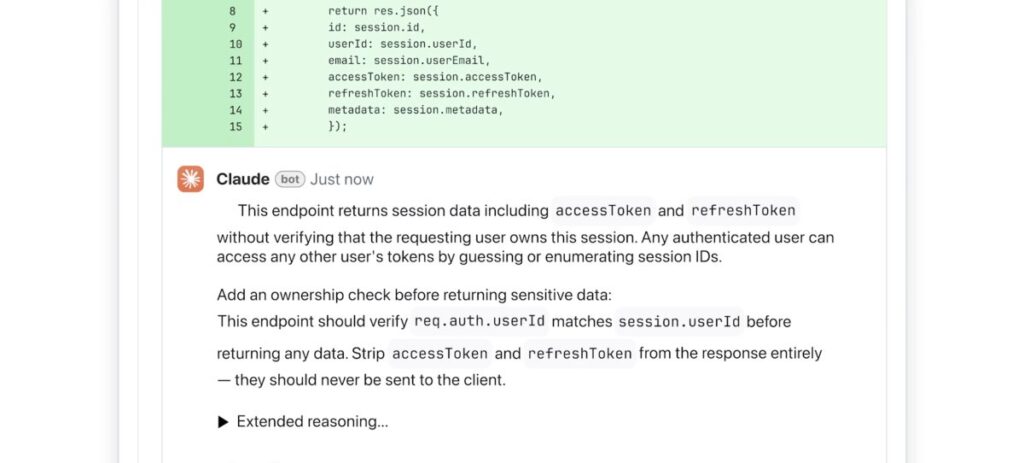

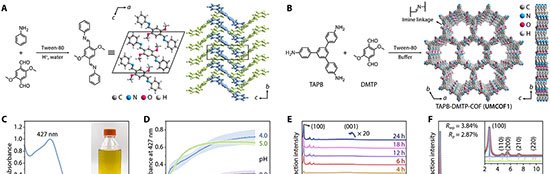

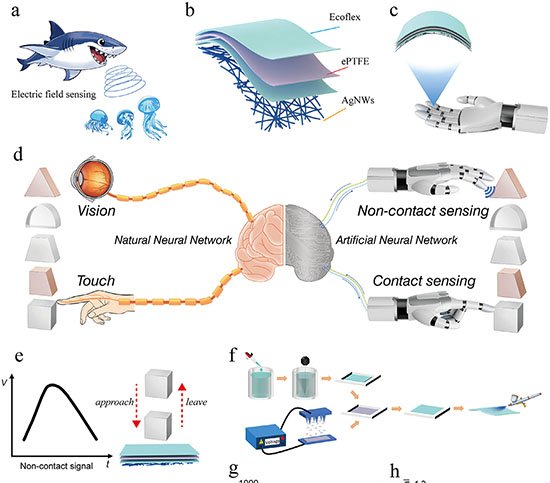

A parceria, classificada pela Anthropic como “aliança”, prevê a adoção do modelo Claude em todas as unidades da Deloitte. Segundo comunicado da startup, as duas empresas criarão produtos e recursos voltados a serviços financeiros, saúde e administração pública. A empresa de consultoria também pretende desenvolver “agentes” de IA que representem áreas internas como contabilidade e desenvolvimento de software.

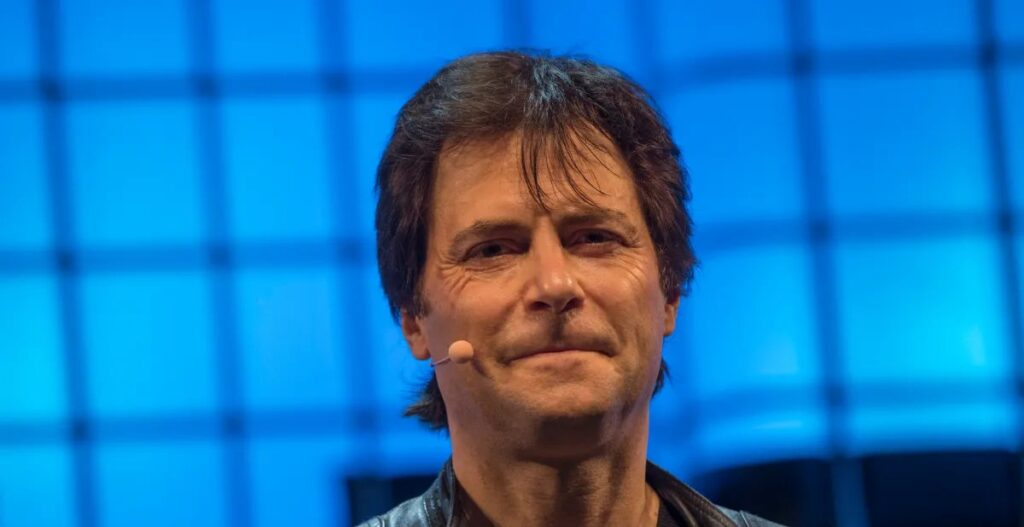

“Estamos investindo de forma significativa porque nossas visões de IA responsável são alinhadas e, juntas, podemos transformar a operação das empresas na próxima década”, afirmou Ranjit Bawa, líder global de tecnologia, ecossistemas e alianças da Deloitte, em postagem no blog da Anthropic.

Os valores do acordo não foram divulgados. A Anthropic destacou que se trata de sua maior implantação corporativa até agora.

Reembolso a agência australiana

No mesmo dia, o Departamento de Emprego e Relações de Trabalho da Austrália informou que a Deloitte devolverá a última parcela de um contrato de 439 mil dólares australianos. O montante refere-se a uma revisão independente entregue pela consultoria que continha erros, entre eles diversas citações a estudos acadêmicos inexistentes. Uma versão corrigida do documento foi publicada na semana passada.

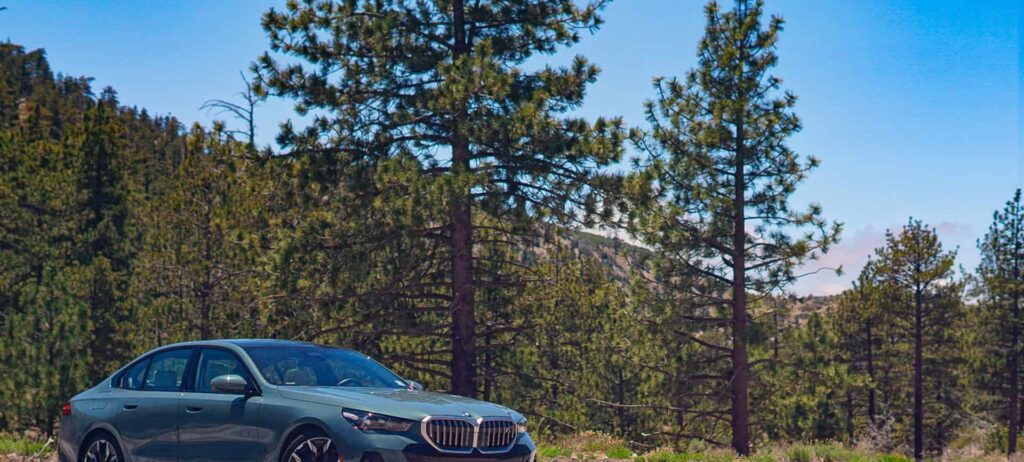

Imagem: Getty

Contexto de alucinações de IA

Casos recentes de informações falsas geradas por IA não se limitam à Deloitte. Em maio, o jornal Chicago Sun-Times precisou admitir que incluiu títulos fictícios em sua lista de leituras de verão gerada por IA. Documentos internos obtidos pela Business Insider apontaram problemas de precisão no Q Business, ferramenta de produtividade da Amazon, durante seu primeiro ano. A própria Anthropic também enfrentou críticas após usar uma citação fabricada por IA em disputa judicial com editoras musicais no início de 2025.

TechCrunch informou ter procurado a Deloitte para comentar o reembolso; até o fechamento desta reportagem, a empresa não havia se pronunciado.

Com informações de TechCrunch