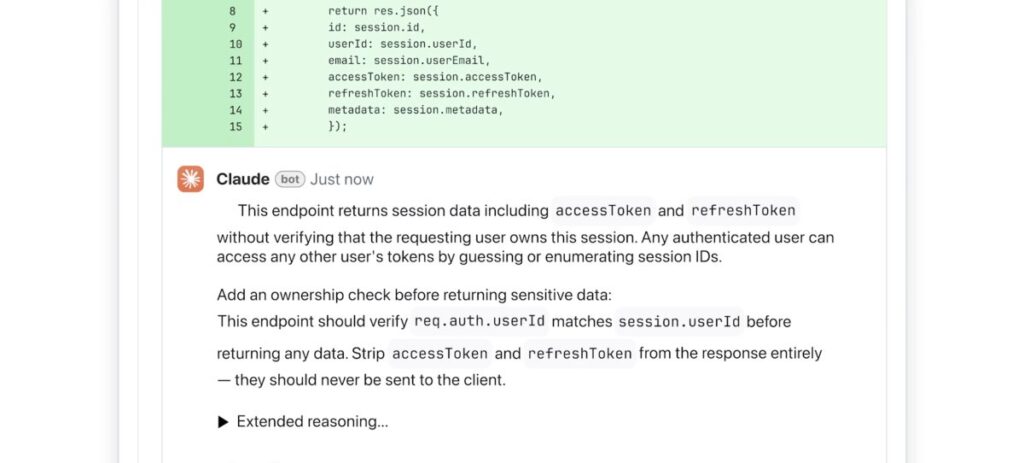

A Google Research anunciou nesta terça-feira, 25 de março de 2026, o TurboQuant, um novo algoritmo de compressão de memória para sistemas de inteligência artificial (IA). A companhia afirma que a técnica consegue encolher o espaço ocupado pelo cache de chaves e valores (KV cache) durante a inferência em, no mínimo, seis vezes, sem perda de desempenho.

Como funciona

Segundo os pesquisadores, o TurboQuant utiliza uma forma de quantização vetorial para eliminar gargalos de cache enquanto mantém a precisão da inferência. O processo se apoia em dois componentes principais:

- PolarQuant – método de quantização responsável pela compactação dos vetores;

- QJL – procedimento de treinamento e otimização que ajusta o modelo para a nova representação comprimida.

Os detalhes técnicos serão apresentados na conferência ICLR 2026, marcada para o próximo mês.

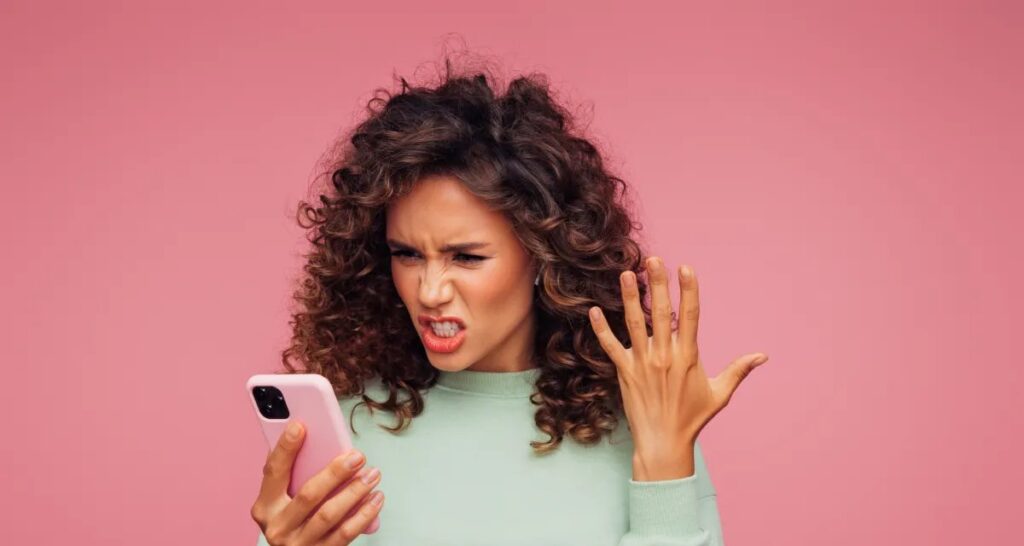

Reação do mercado

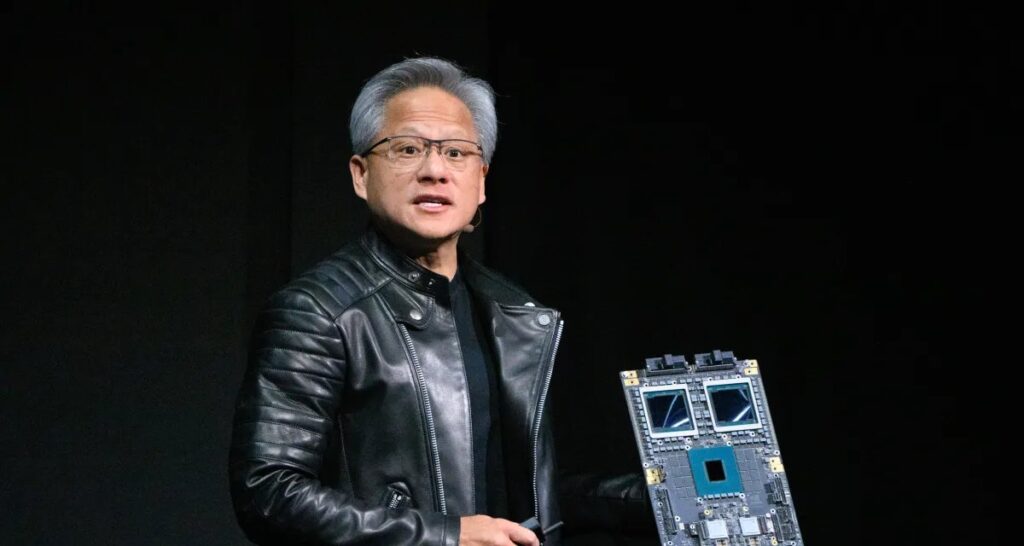

Logo após o anúncio, usuários nas redes sociais passaram a comparar o TurboQuant à startup fictícia Pied Piper, da série “Silicon Valley”, famosa por um algoritmo de compressão quase sem perdas. Entre as publicações, o diretor-executivo da Cloudflare, Matthew Prince, classificou o avanço como o “momento DeepSeek” do Google — referência ao modelo chinês treinado com custo reduzido e alto nível de eficiência.

Aplicações e limitações

Por enquanto, o TurboQuant permanece em fase de laboratório. A tecnologia foca apenas na redução de memória durante a inferência e não resolve a demanda por grandes volumes de RAM necessária no treinamento de modelos. Mesmo assim, se implementada em escala, pode tornar a operação de IA mais barata, rápida e econômica em energia.

Imagem: Internet

Não há previsão oficial para adoção comercial do TurboQuant.

Com informações de TechCrunch