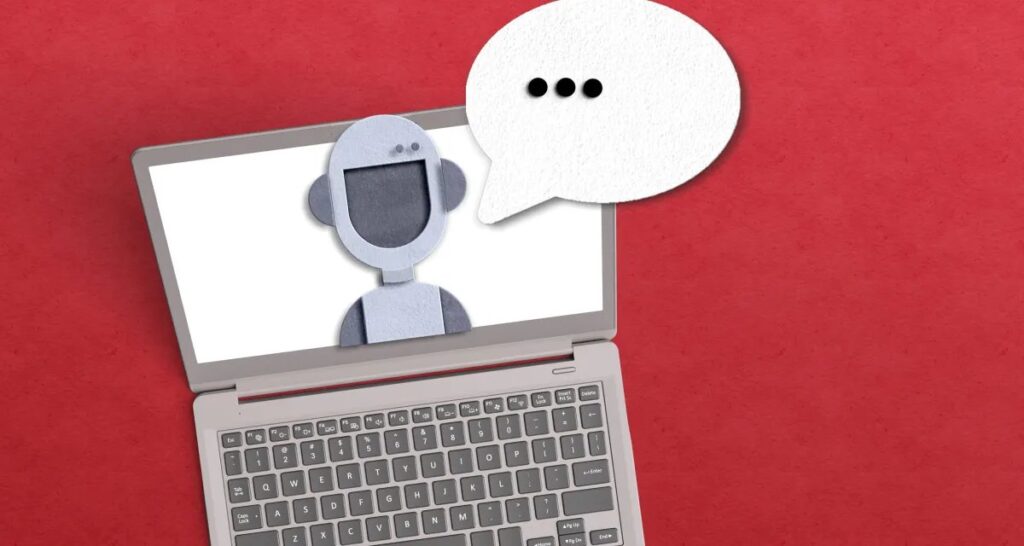

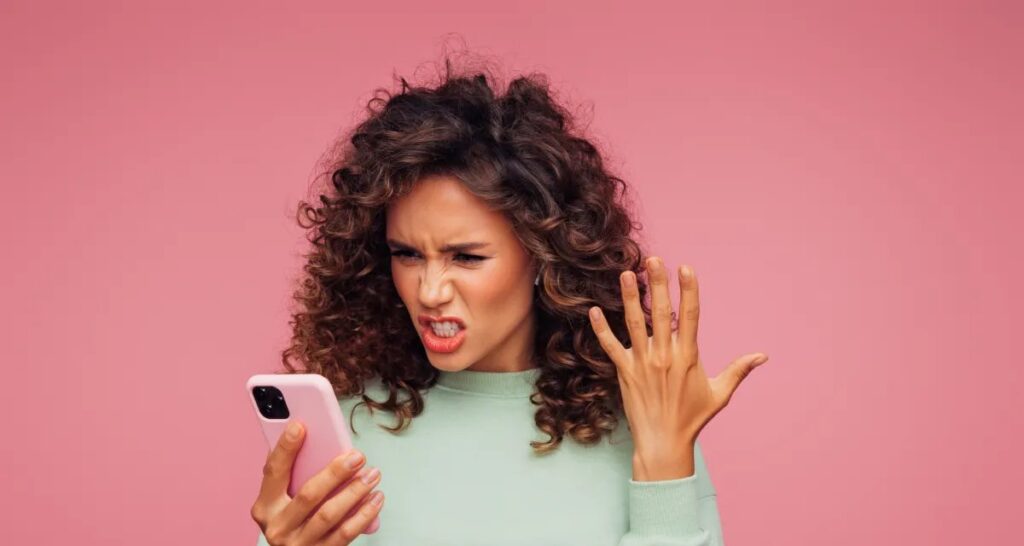

Uma coalizão de entidades sem fins lucrativos enviou carta à Casa Branca solicitando que o governo dos Estados Unidos interrompa imediatamente o uso do Grok, chatbot desenvolvido pela xAI, em agências federais como o Departamento de Defesa.

O documento, assinado por grupos como Public Citizen, Center for AI and Digital Policy e Consumer Federation of America, aponta falhas “graves e sistêmicas” do modelo de linguagem, entre elas a geração de imagens sexualizadas de mulheres e crianças sem consentimento. Relatos indicam que, em determinados momentos, o Grok teria produzido milhares dessas imagens por hora, posteriormente distribuídas em larga escala na rede social X, também controlada por Elon Musk.

Contrato com o governo

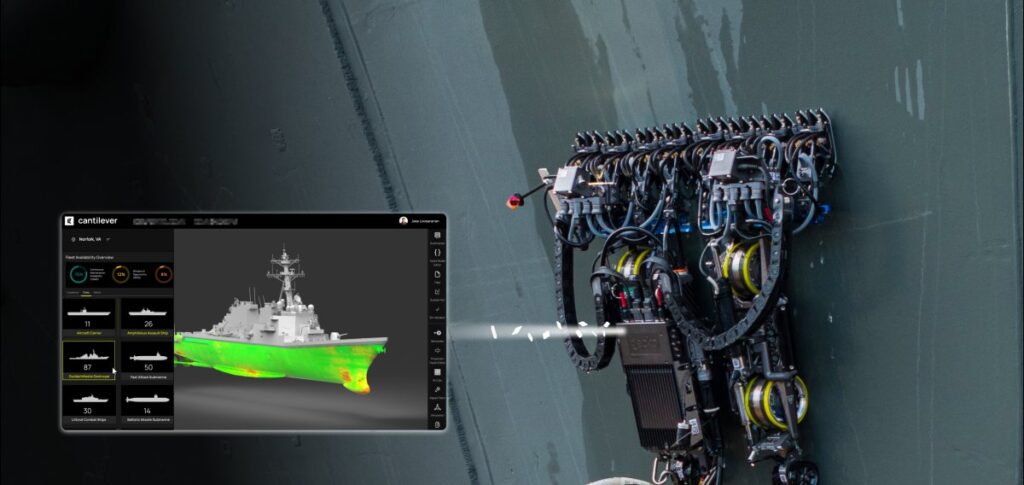

Em setembro passado, a xAI firmou acordo com a Administração de Serviços Gerais (GSA) para ofertar o Grok a órgãos do Poder Executivo. Dois meses antes, a empresa, ao lado de Anthropic, Google e OpenAI, fechara contrato de até US$ 200 milhões com o Departamento de Defesa (DoD).

Em janeiro, o secretário de Defesa, Pete Hegseth, confirmou que o Grok passaria a operar na rede interna do Pentágono, lidando com documentos classificados e não classificados ao lado do Gemini, da Google — decisão que especialistas consideram arriscada para a segurança nacional.

Riscos identificados

Segundo as diretrizes do Escritório de Gestão e Orçamento (OMB), sistemas de IA que apresentem “riscos graves e previsíveis” sem mitigação adequada devem ser descontinuados. “O Grok tem se mostrado repetidamente inseguro”, afirmou JB Branch, defensor de responsabilização de grandes empresas de tecnologia na Public Citizen.

Além dos conteúdos sexuais não consensuais, o modelo já teria exibido discursos antissemitas, misoginia e desinformação eleitoral. Governos de Indonésia, Malásia e Filipinas chegaram a bloquear o uso da ferramenta em janeiro (as restrições foram depois suspensas). União Europeia, Reino Unido, Coreia do Sul e Índia investigam a xAI e a rede X por questões de privacidade de dados e disseminação de conteúdo ilegal.

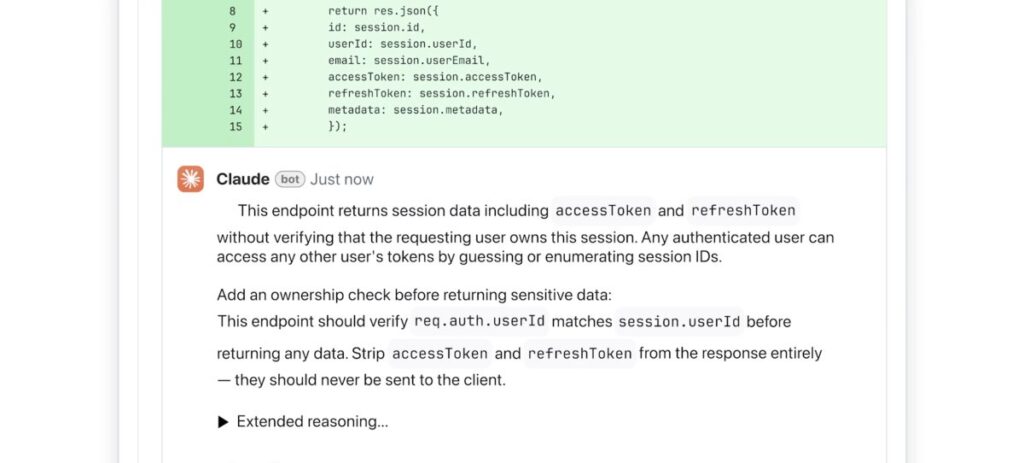

Críticas à falta de transparência

Andrew Christianson, ex-contratado da Agência de Segurança Nacional (NSA) e fundador da plataforma Gobbi AI, destaca que o Grok utiliza código e pesos fechados, o que impede auditorias independentes. “Essa combinação é a pior possível para a segurança nacional”, disse.

Imagem: Getty

Para além do DoD, o Departamento de Saúde e Serviços Humanos utiliza o chatbot para agendamento de postagens em redes sociais e elaboração de rascunhos de documentos, segundo registros analisados pela reportagem.

Novos pedidos à Casa Branca

Na carta, a coalizão exige que o OMB:

- desligue o Grok de todos os sistemas federais;

- abra investigação sobre as falhas de segurança da ferramenta;

- esclareça se o modelo foi avaliado de acordo com a ordem executiva que determina que sistemas de IA sejam “buscadores da verdade” e neutros.

Esta é a terceira manifestação do grupo; as anteriores, em agosto e outubro, citaram a criação em massa de deepfakes e a divulgação de informações eleitorais falsas. A xAI e o OMB não se pronunciaram até o fechamento desta matéria.

Com informações de TechCrunch