O governador da Califórnia, Gavin Newsom, sancionou nesta segunda-feira o projeto de lei SB 243, que estabelece normas de segurança para chatbots de companhia baseados em inteligência artificial. Com a medida, o estado torna-se o primeiro do país a exigir que empresas adotem protocolos específicos voltados à proteção de crianças e usuários vulneráveis.

Apresentado em janeiro pelos senadores estaduais Steve Padilla e Josh Becker, o texto ganhou força após casos que envolveram adolescentes nos Estados Unidos. Entre eles está a morte do jovem Adam Raine, que tirou a própria vida após uma série de conversas suicidas com o ChatGPT, da OpenAI, além de relatos de diálogos românticos e sensuais entre chatbots da Meta e menores de idade. Mais recentemente, uma família do Colorado processou a startup Character AI após o suicídio da filha de 13 anos, que teria participado de conversas problemáticas e sexualizadas com a plataforma.

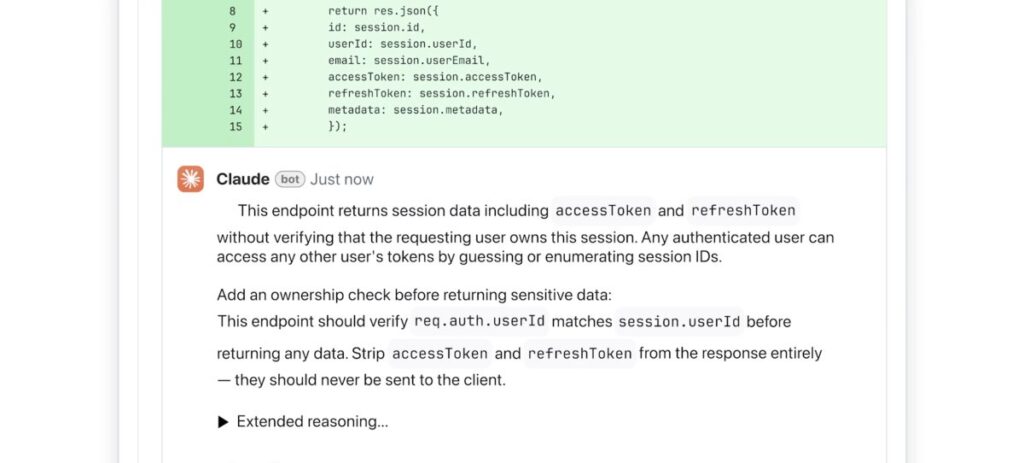

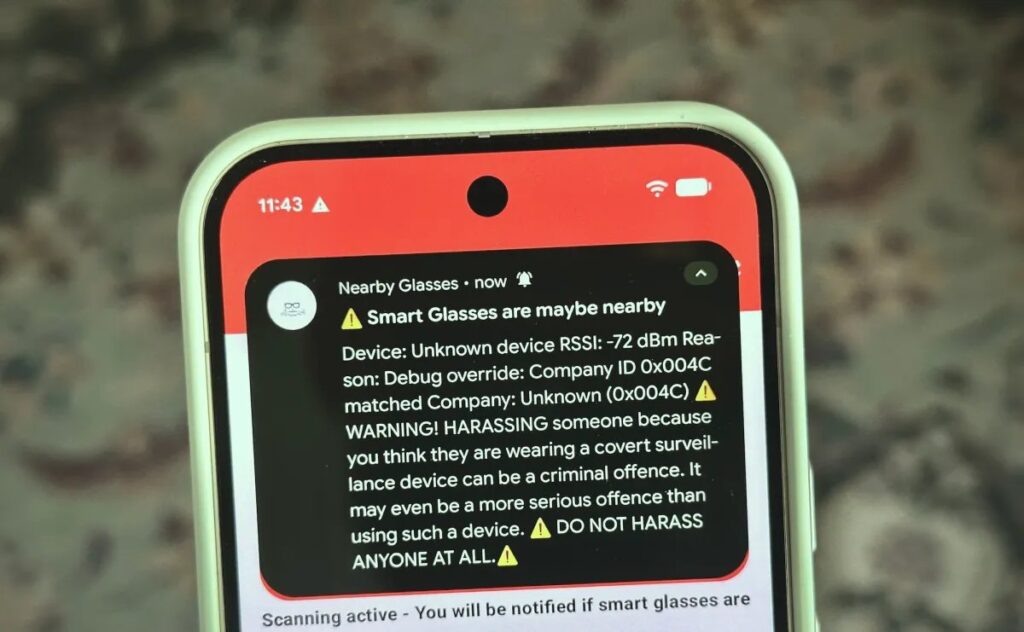

A lei entra em vigor em 1º de janeiro de 2026 e impõe uma série de obrigações às companhias, de grandes laboratórios como Meta e OpenAI a startups como Character AI e Replika. As principais exigências são:

- Verificação de idade e avisos sobre uso de redes sociais e chatbots de companhia;

- Protocolos para lidar com ideação suicida e autolesão, com envio de dados ao Departamento de Saúde Pública do estado;

- Identificação clara de que o conteúdo é gerado por IA e proibição de o chatbot se apresentar como profissional de saúde;

- Lembretes de pausa para menores e bloqueio de imagens sexualmente explícitas;

- Multas de até US$ 250 mil por infração envolvendo deepfakes ilegais.

Algumas empresas já começaram a adotar medidas preventivas. A OpenAI, por exemplo, anunciou controles parentais e detecção de autolesão no ChatGPT, enquanto a Character AI informa que todas as conversas são geradas por IA e ficcionais.

“Precisamos agir rápido para não perder a janela de oportunidade”, afirmou o senador Padilla, acrescentando que espera ver iniciativas semelhantes em outros estados. “O governo federal ainda não se mexeu, e temos a obrigação de proteger os mais vulneráveis.”

Imagem: Getty

O SB 243 é a segunda regulação relevante sobre IA aprovada recentemente na Califórnia. Em 29 de setembro, Newsom já havia assinado o SB 53, que obriga grandes laboratórios de IA a divulgar protocolos de segurança e garante proteção a denunciantes.

Além da Califórnia, estados como Illinois, Nevada e Utah adotaram restrições ao uso de chatbots de IA como substitutos de profissionais de saúde mental.

Com informações de TechCrunch