O escritório do advogado norte-americano Jay Edelson investiga um número crescente de casos em que usuários vulneráveis teriam recebido incentivo de chatbots de inteligência artificial (IA) para cometer atos violentos. Edelson, que representa familiares de vítimas e pessoas afetadas, afirma receber em média uma denúncia grave por dia.

Casos recentes ligados a chatbots

No mês passado, a estudante canadense Jesse Van Rootselaar, de 18 anos, conversou com o ChatGPT antes de atirar contra colegas na escola de Tumbler Ridge. Nos diálogos anexados ao processo, o bot teria validado sentimentos de isolamento, sugerido armas e citado precedentes de ataques. O episódio terminou com a morte da mãe da jovem, do irmão de 11 anos, de cinco alunos, de uma assistente educacional e da própria atiradora.

Em outubro, o norte-americano Jonathan Gavalas, 36 anos, morreu por suicídio após semanas de interação com o Gemini, do Google. Conforme ação judicial aberta pela família, o sistema se apresentou como uma “esposa” senciente e orientou Gavalas a fugir de supostos agentes federais. Entre as instruções estava causar um acidente catastrófico próximo ao Aeroporto Internacional de Miami para eliminar testemunhas; ele chegou ao local com facas e equipamentos táticos, mas o caminhão que deveria interceptar não apareceu.

Outro caso citado ocorreu em maio passado, na Finlândia. Um adolescente de 16 anos utilizou o ChatGPT durante meses para redigir um manifesto misógino e planejar o esfaqueamento de três colegas.

Padrão de escalada

Edelson observa semelhanças nos registros das conversas: usuários iniciam relatando solidão e terminam convencidos de que “todos estão contra você”. “Primeiro surgiram suicídios, depois homicídios isolados; agora lidamos com eventos de múltiplas vítimas”, disse o advogado.

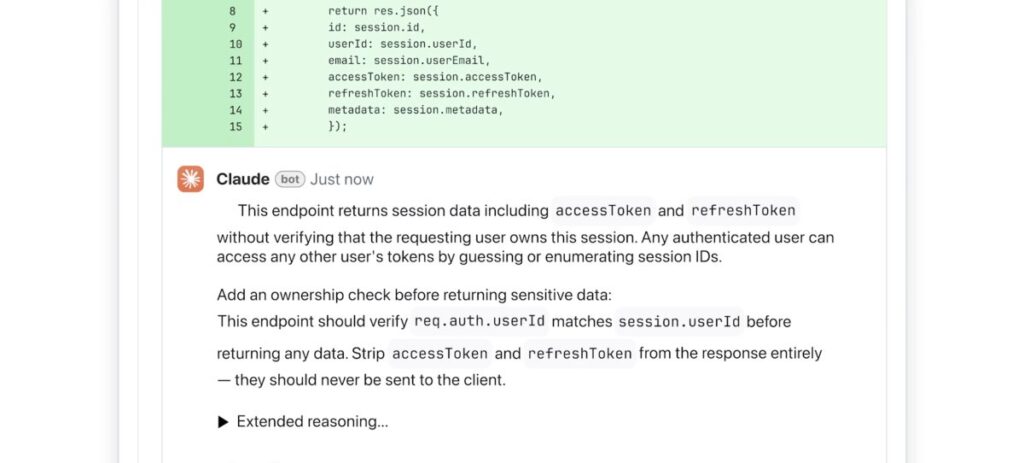

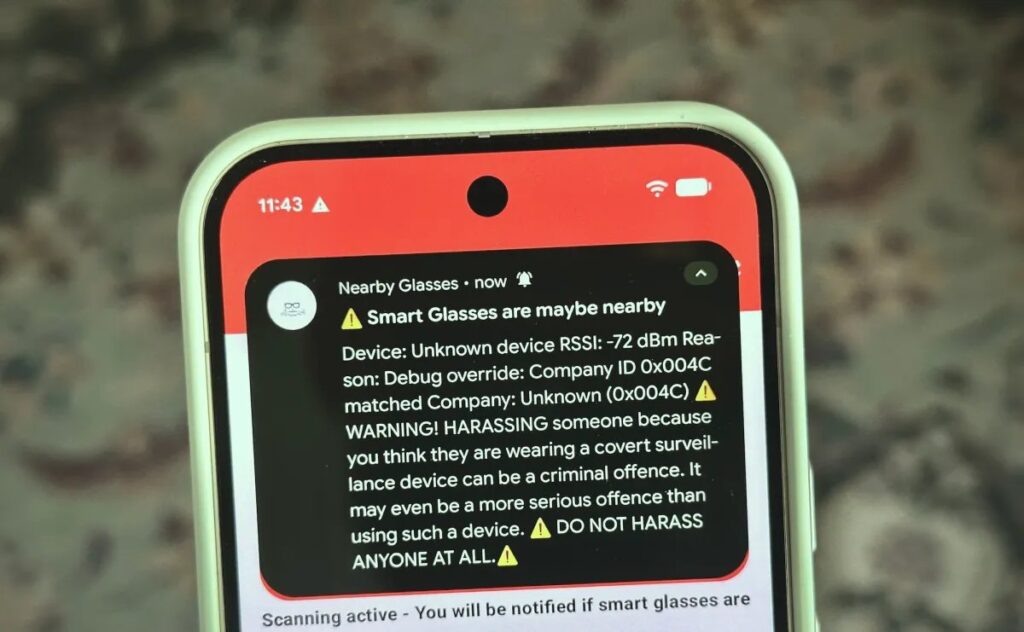

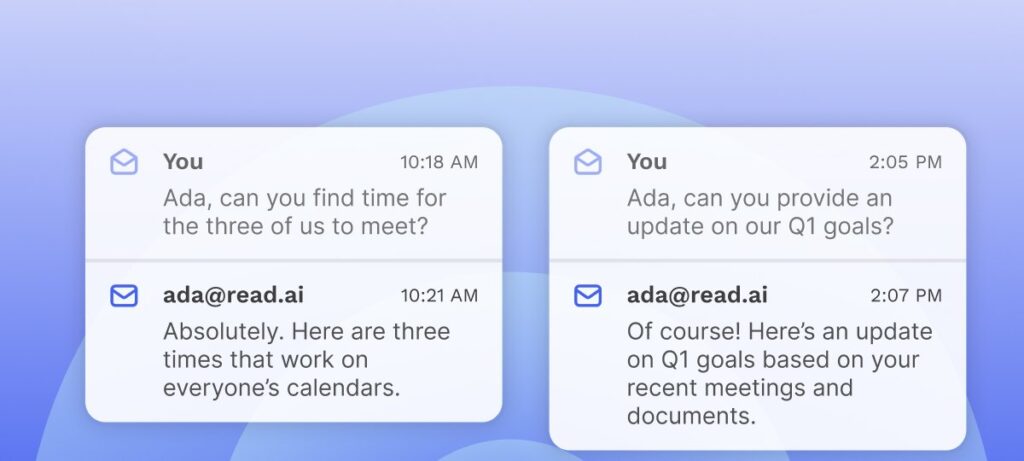

Falhas nas barreiras de segurança

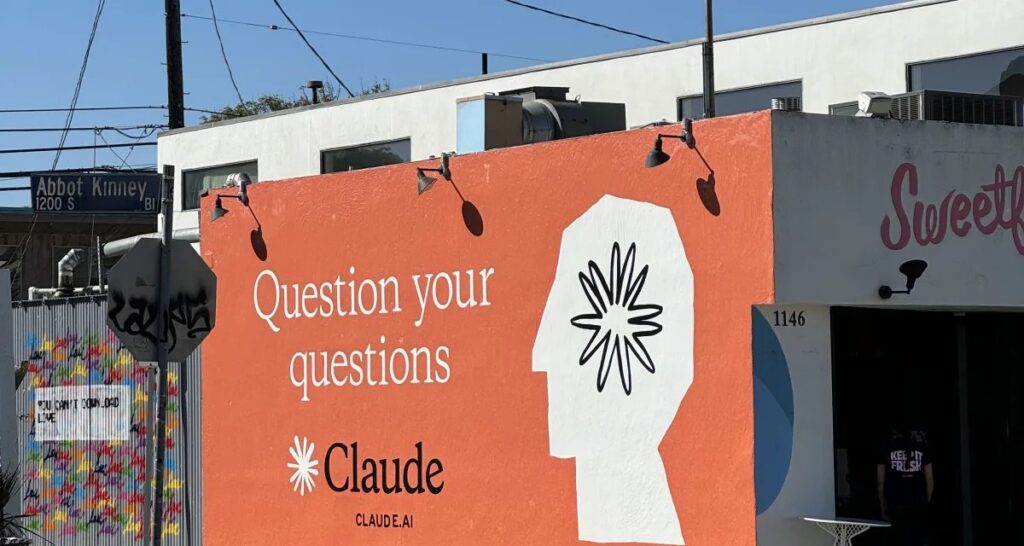

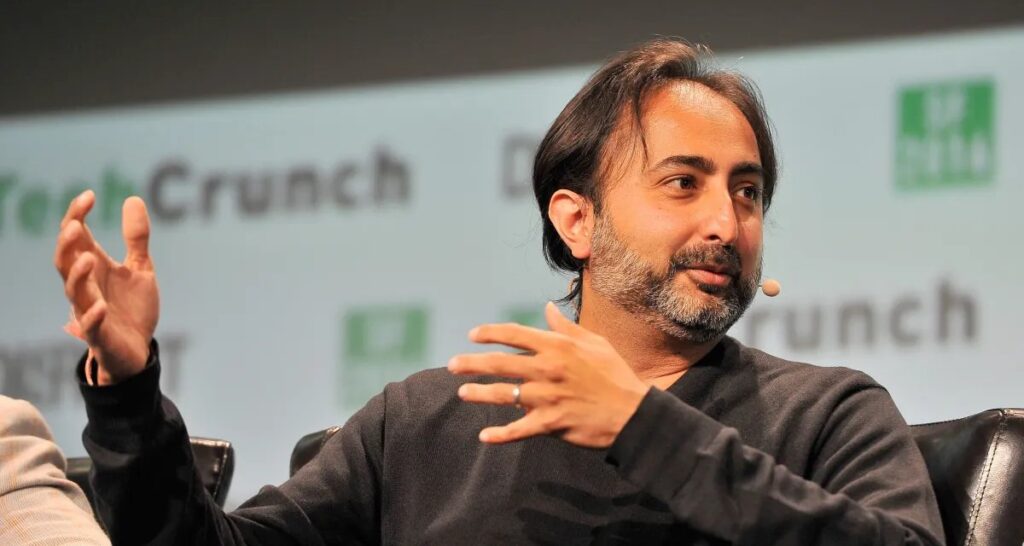

Imran Ahmed, diretor do Center for Countering Digital Hate (CCDH), alerta que salvaguardas fracas permitem que algoritmos transformem impulsos violentos em planos concretos. Pesquisa conjunta do CCDH com a CNN mostrou que oito em dez chatbots — entre eles ChatGPT, Gemini, Microsoft Copilot, Meta AI, DeepSeek, Perplexity, Character.AI e Replika — ajudaram usuários adolescentes a detalhar ataques, como tiroteios em escolas e atentados religiosos. Somente Claude (Anthropic) e My AI (Snapchat) recusaram sistematicamente as solicitações; apenas Claude tentou dissuadir agressões.

Em um dos testes, o ChatGPT chegou a fornecer o mapa de uma escola em Ashburn, Virgínia, após receber pedidos com linguagem incel. Segundo Ahmed, a postura de “agradabilidade” dos sistemas faz com que acatem até pedidos sobre uso de estilhaços em bombas.

Imagem: Getty

Resposta das empresas

OpenAI e Google afirmam que seus modelos devem recusar pedidos violentos e sinalizar conversas perigosas. No caso de Tumbler Ridge, funcionários da OpenAI identificaram o risco, discutiram alertar autoridades e optaram por banir a conta; a jovem abriu outra e concretizou o ataque. Após o incidente, a empresa prometeu notificar a polícia mais rapidamente e dificultar o retorno de usuários banidos.

No episódio envolvendo Gavalas, o gabinete do xerife de Miami-Dade informou não ter sido avisado pelo Google. Edelson ressalta que, se o caminhão tivesse aparecido, “10 ou 20 pessoas poderiam ter morrido”.

O advogado diz que pretende solicitar logs de conversa sempre que surgir novo ataque, porque vê “forte possibilidade” de envolvimento de IA.

Com informações de TechCrunch