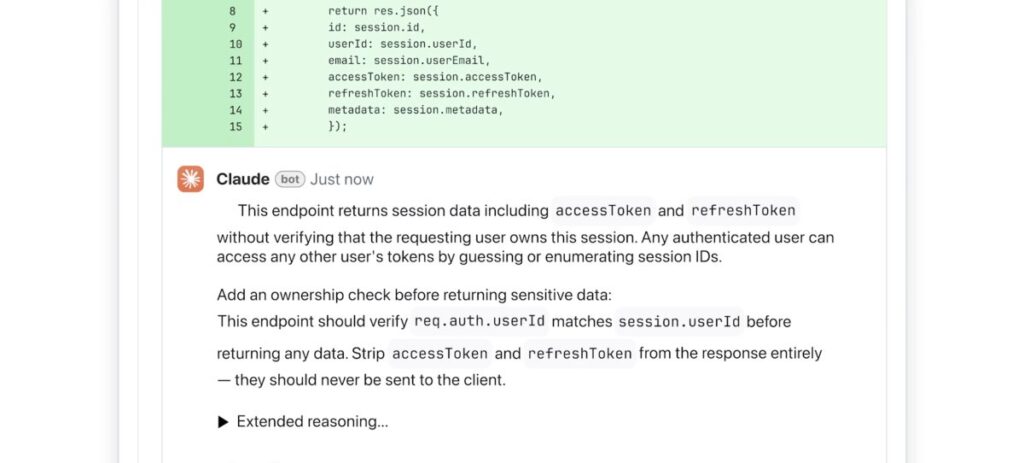

Quase dois anos após o presidente da Microsoft, Satya Nadella, prever que a inteligência artificial substituiria o trabalho intelectual, uma nova avaliação coloca esse cenário em dúvida. O estudo, conduzido pela Mercor, gerou o Apex-Agents, um benchmark que mede o desempenho de agentes de IA em atividades típicas de consultoria, banco de investimento e advocacia.

Os resultados mostram que nenhum dos principais modelos superou 25% de acerto em respostas de primeira tentativa. O melhor colocado, Gemini 3 Flash, atingiu 24% de precisão, seguido por GPT-5.2 com 23%. Opus 4.5, Gemini 3 Pro e GPT-5 ficaram em torno de 18%.

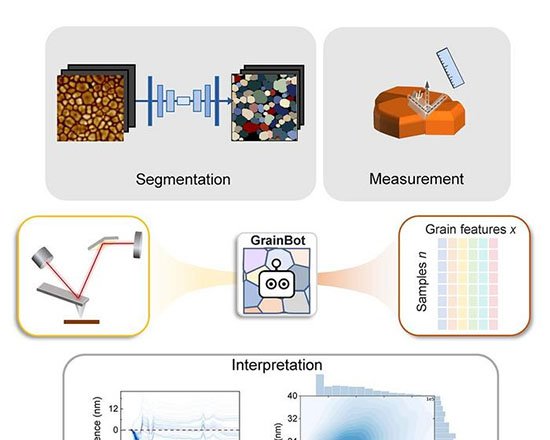

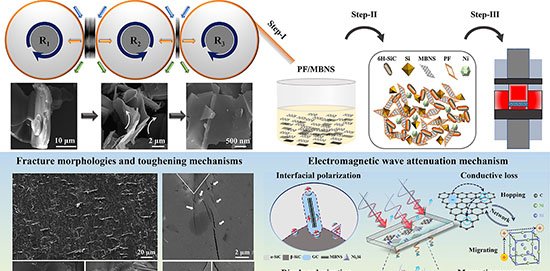

Como o teste foi estruturado

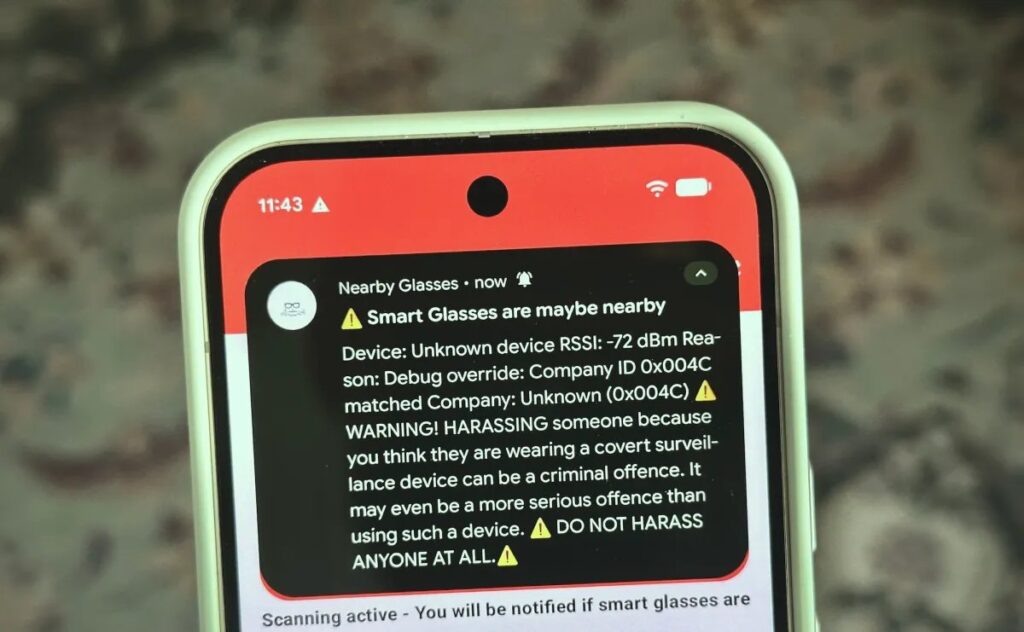

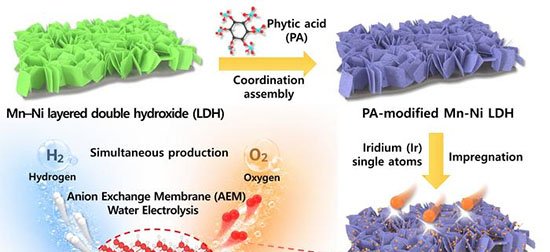

Segundo o pesquisador Brendan Foody, a principal dificuldade dos modelos está em reunir informações espalhadas por diferentes fontes, cenário comum em ambientes corporativos que usam Slack, Google Drive e outras ferramentas. “Montamos todo o ambiente para refletir serviços profissionais reais”, explicou.

Os cenários foram elaborados por especialistas que atuam na plataforma da Mercor e publicados no Hugging Face. Entre as perguntas, uma questão jurídica exigia avaliar logs exportados para os Estados Unidos durante uma pane na União Europeia e decidir se a prática se enquadrava no Artigo 49 do RGPD; a resposta correta era “sim”.

Diferenças em relação a outros benchmarks

O Apex-Agents foca em tarefas prolongadas dentro de poucas profissões de alto valor, enquanto o GDPVal, da OpenAI, avalia conhecimento geral em várias áreas. Essa abordagem mais restrita torna o novo teste mais difícil, mas também mais próximo da rotina de bancários de investimento, consultores e advogados.

Imagem: Getty

Expectativas para os próximos meses

Embora os números atuais sejam baixos, Foody lembra que, há um ano, o desempenho desses sistemas ficava entre 5% e 10%. “Hoje a IA parece um estagiário que acerta um quarto das vezes”, disse, acrescentando que espera avanços rápidos agora que o benchmark está disponível publicamente.

Com informações de TechCrunch