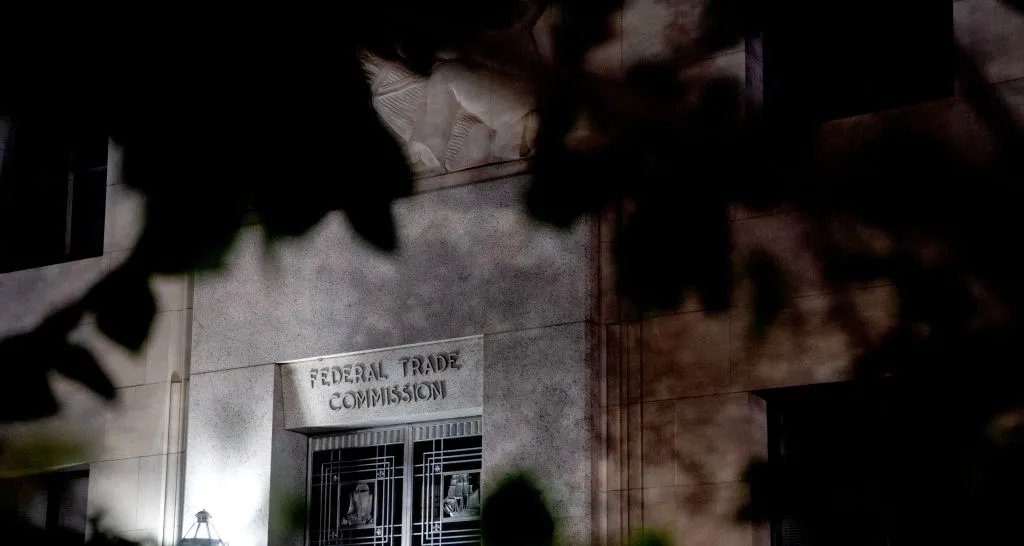

O governador da Califórnia, Gavin Newsom, assinou nesta semana o projeto SB 53, que estabelece exigências inéditas de transparência e segurança para grandes laboratórios de inteligência artificial. A norma, considerada a primeira do tipo nos Estados Unidos, determina que as empresas publiquem e cumpram protocolos voltados a evitar riscos catastróficos, como o uso de modelos para ataques cibernéticos contra infraestrutura crítica ou a criação de armas biológicas.

“Os formuladores de políticas sabem que é possível proteger a inovação e, ao mesmo tempo, garantir a segurança dos produtos”, afirmou Adam Billen, vice-presidente de políticas públicas da organização juvenil Encode AI. Segundo ele, a SB 53 demonstra que regulamentação e desenvolvimento tecnológico não precisam entrar em choque.

Além da divulgação, o texto torna obrigatória a adoção efetiva desses protocolos, cuja fiscalização ficará a cargo do Office of Emergency Services do estado. Billen observou que muitos laboratórios já realizam testes de segurança e divulgam model cards, mas alertou que alguns “afrouxam padrões” diante da concorrência. Como exemplo, citou a posição pública da OpenAI de possivelmente reduzir exigências se competidores lançarem sistemas de alto risco sem salvaguardas equivalentes.

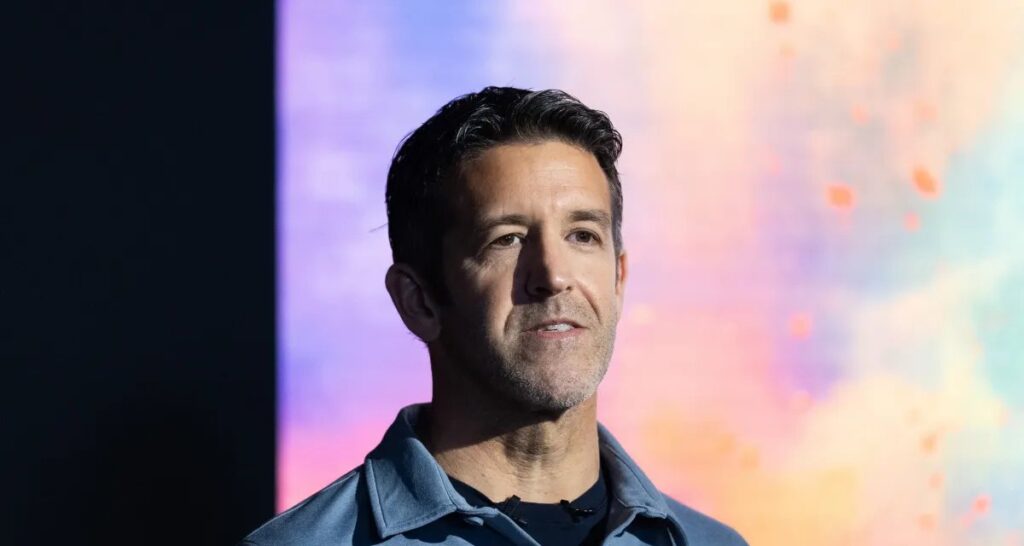

A oposição pública ao projeto foi menor do que à proposta anterior, SB 1047, vetada por Newsom em 2024. Ainda assim, empresas como Meta, investidores do Vale do Silício e figuras influentes — entre elas Greg Brockman, presidente da OpenAI — destinam centenas de milhões de dólares a super PACs que apoiam candidatos favoráveis a uma abordagem mais branda. O grupo também defendeu, no início do ano, uma moratória de dez anos que impediria estados de regulamentar a IA, iniciativa derrotada por uma coalizão de mais de 200 entidades lideradas pela Encode AI.

O debate continua no Congresso. O senador Ted Cruz (republicano do Texas) apresentou em setembro o SANDBOX Act, que permitiria às empresas solicitar isenções de determinadas regras federais por até dez anos. Billen prevê ainda a apresentação de um projeto que criaria um padrão nacional de IA, com potencial de anular legislações estaduais como a SB 53.

Para o dirigente da Encode AI, a eliminação de normas locais prejudicaria temas como combate a deepfakes, transparência algorítmica, discriminação, proteção infantil e uso governamental da IA. Ele ressalta que a disputa tecnológica com a China seria melhor endereçada por medidas de controle de exportação de chips — foco de iniciativas como o Chip Security Act — e pelo fortalecimento da produção doméstica contemplado no CHIPS and Science Act.

Imagem: Getty

Empresas de tecnologia, entre elas Nvidia e OpenAI, manifestaram reservas a certos dispositivos desses projetos, citando eventuais impactos na competitividade e na segurança. A Nvidia, que obtém parte significativa da receita na China, tem interesse direto na manutenção das vendas ao país. Em abril de 2025, o governo Trump chegou a ampliar o bloqueio de chips avançados, mas reverteu parte da decisão três meses depois, permitindo que Nvidia e AMD comercializassem alguns modelos em troca de 15% do faturamento.

“A SB 53 é um exemplo de como indústria e legisladores podem chegar a um texto que contemple diferentes interesses”, concluiu Billen, enfatizando que o processo — embora “complexo e por vezes turbulento” — reflete o funcionamento da democracia e do federalismo norte-americanos.

Com informações de TechCrunch