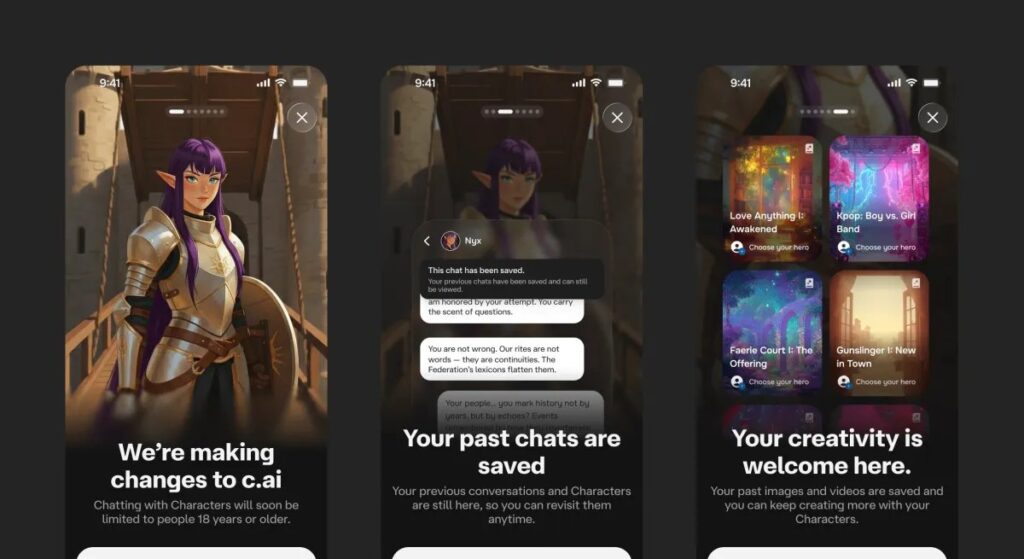

São Francisco (EUA) – A Character.AI vai desativar, até 25 de novembro, todas as conversas abertas entre chatbots e usuários menores de 18 anos. A medida foi anunciada pelo presidente-executivo Karandeep Anand após processos judiciais e protestos públicos ligados ao suicídio de pelo menos dois adolescentes que mantiveram longos diálogos na plataforma.

Segundo Anand, a empresa começará já nas próximas semanas a impor um limite diário de duas horas para menores, tempo que será reduzido gradualmente até chegar a zero. O objetivo é substituir o formato de “companheiro virtual” por experiências de criação coletiva, como elaboração de histórias e geração de imagens.

Como funcionará o bloqueio

A verificação de idade combinará um sistema interno de análise de comportamento com ferramentas externas, entre elas a Persona. Caso esses recursos não confirmem a idade, serão solicitados reconhecimento facial e checagem de documento de identidade, informou o executivo.

Perdas previstas e novas frentes de negócio

A Character.AI já havia lançado controles para pais, filtros de personagens, restrições a diálogos românticos e alertas de tempo de uso — mudanças que reduziram consideravelmente a base juvenil. Anand admite que a retirada total das conversas abertas deverá gerar nova evasão, mas aposta que parte dos adolescentes migrará para os recursos lançados nos últimos meses:

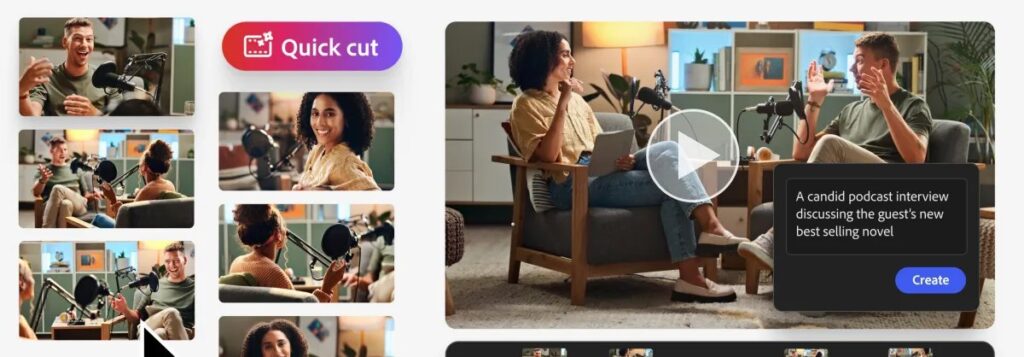

- AvatarFX (junho): transforma imagens em vídeos animados;

- Scenes: roteiros interativos com personagens pré-definidos;

- Streams: interação dinâmica entre dois personagens;

- Community Feed (agosto): feed para compartilhar criações na plataforma.

Contexto regulatório

A decisão antecipa possíveis exigências legais. Nos Estados Unidos, os senadores Josh Hawley (republicano-MO) e Richard Blumenthal (democrata-CT) pretendem apresentar projeto que proíbe chatbots companheiros para menores. A Califórnia, por sua vez, tornou-se neste mês o primeiro estado a estabelecer padrões de segurança específicos para esses sistemas.

Imagem: Internet

Novo laboratório de segurança

Além das mudanças na plataforma, a empresa vai criar e financiar o AI Safety Lab, entidade sem fins lucrativos dedicada a pesquisas de alinhamento seguro para produtos de entretenimento baseados em inteligência artificial.

“Espero que nosso posicionamento se torne o padrão do setor”, declarou Anand. “Tenho uma filha de seis anos e quero que ela cresça em um ambiente seguro, com IA responsável.”

Com informações de TechCrunch