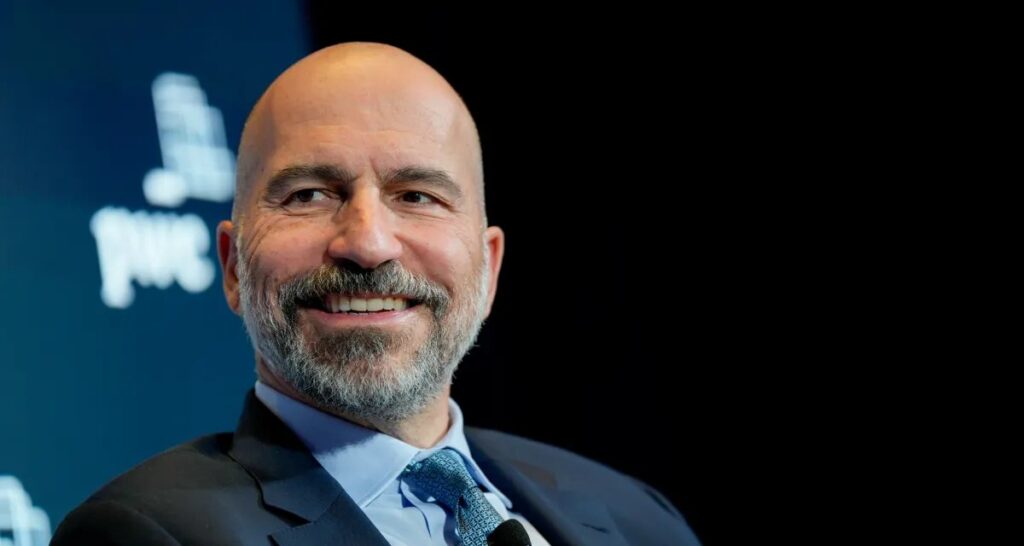

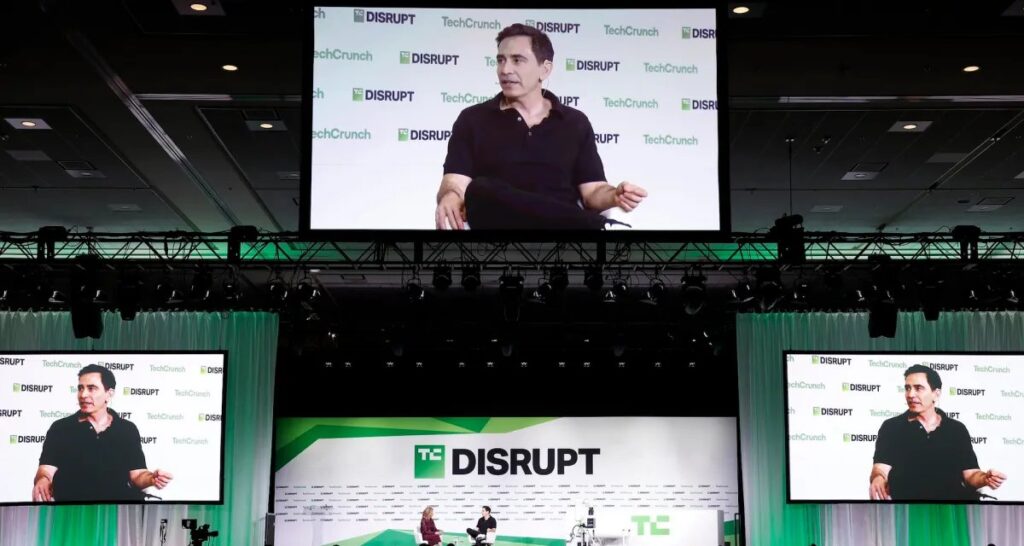

Washington, 27 de fevereiro de 2026 – A startup de IA Anthropic e o Departamento de Defesa dos Estados Unidos (DoD) entraram em rota de colisão sobre as regras de aplicação militar de sistemas de inteligência artificial. O impasse coloca frente a frente o presidente-executivo da empresa, Dario Amodei, e o secretário de Defesa, Pete Hegseth.

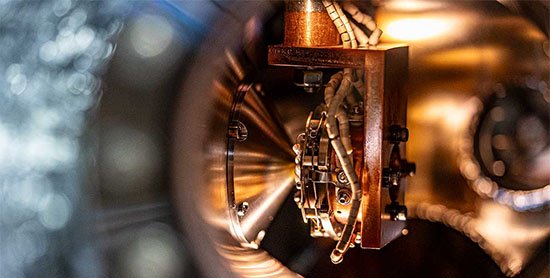

Amodei mantém a posição de que os modelos da Anthropic não podem ser usados para vigilância em massa de cidadãos norte-americanos nem para armamentos totalmente autônomos, capazes de selecionar e atacar alvos sem intervenção humana. Hegseth, por sua vez, defende que o Pentágono tem o direito de empregar qualquer tecnologia de forma “legalmente permitida” e não aceita ser restringido pelas diretrizes internas de um fornecedor.

Na quinta-feira (26), Amodei reafirmou publicamente que não recuará, mesmo diante da ameaça de a empresa ser classificada como “risco na cadeia de suprimentos”, o que a excluiria de contratos governamentais. O Pentágono fixou prazo até as 17h01 (horário da Costa Leste) desta sexta-feira para que a Anthropic reveja sua política; caso contrário, o acordo será rescindido e a companhia poderá ser enquadrada na Lei de Produção de Defesa (DPA), forçando a adaptação de seus sistemas às necessidades militares.

Armas autônomas e vigilância ampliada

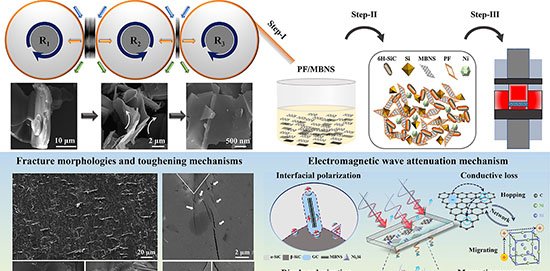

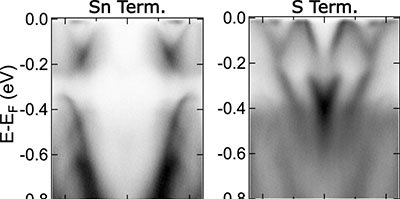

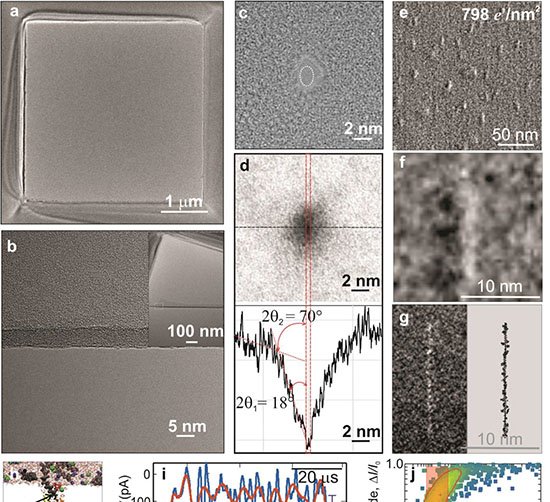

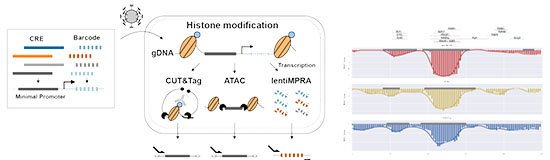

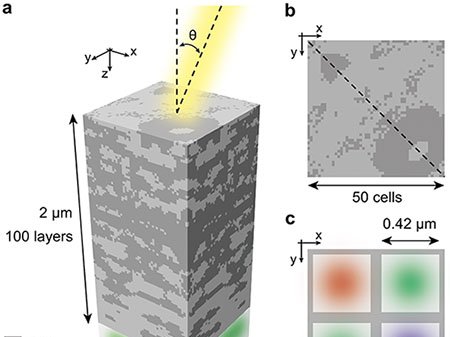

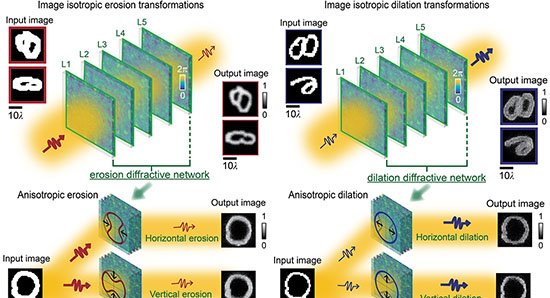

Embora o DoD já utilize plataformas altamente automatizadas, a diretriz de 2023 permite que sistemas de IA selecionem e engajem alvos sem supervisão humana, desde que passem por avaliação de autoridades superiores. Para a Anthropic, tecnologias ainda imaturas podem cometer erros fatais, como identificar incorretamente um alvo ou escalar conflitos sem autorização humana.

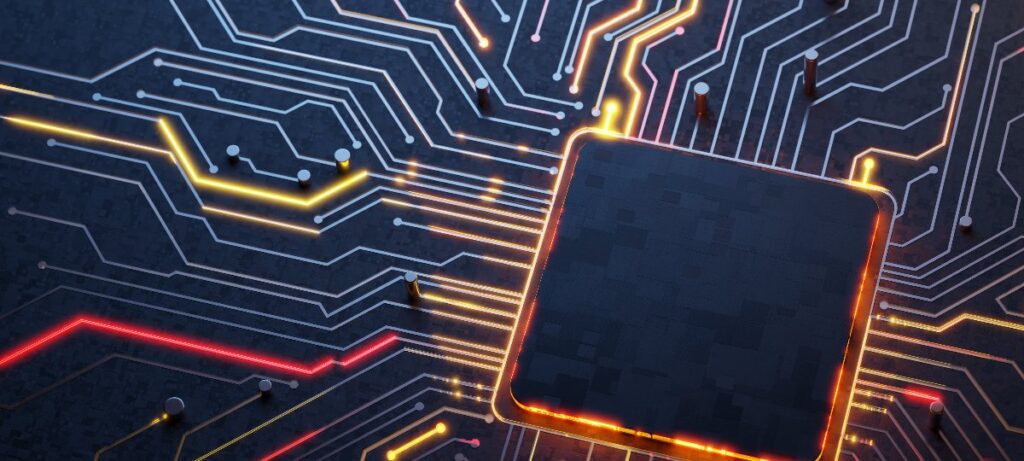

Além do uso bélico, a empresa aponta riscos de expansão da vigilância interna. Leis atuais já possibilitam coleta de comunicações de cidadãos, mas algoritmos avançados podem elevar essa prática a um novo patamar, com análise contínua de padrões e pontuação preditiva de risco.

Pressão pública e prazo final

Em publicação na rede X, o porta-voz do Pentágono, Sean Parnell, declarou que o departamento “não tem interesse em vigilância doméstica em massa nem em armas autônomas”, pedindo apenas que a Anthropic permita todas as utilizações consideradas legais. “Não deixaremos nenhuma empresa ditar como tomamos decisões operacionais”, escreveu.

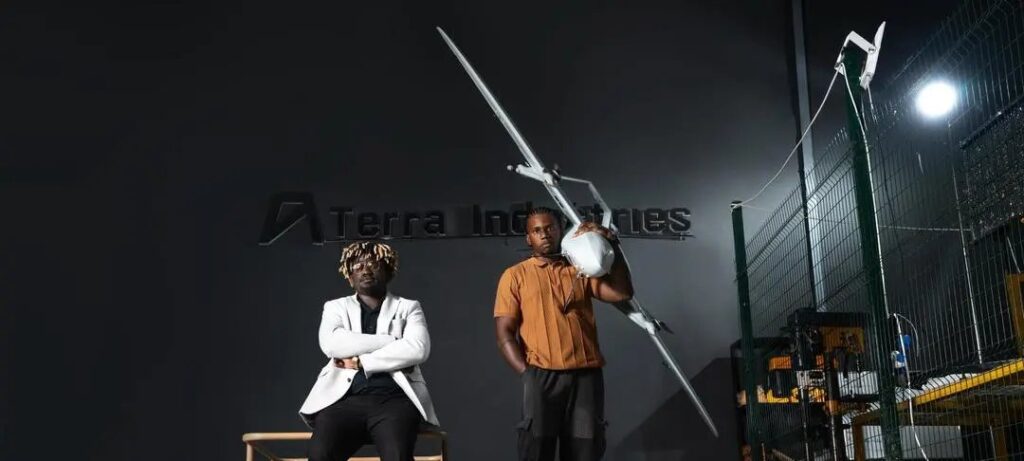

Imagem: Getty

A tensão também ganhou contornos ideológicos. Em discurso a funcionários da SpaceX e da xAI em janeiro, Hegseth criticou o que chamou de “IA woke” e afirmou que o objetivo é “construir armas e sistemas prontos para a guerra, não chatbots de sala de professores da Ivy League”.

Consequências para indústria e segurança

Segundo o investidor Sachin Seth, da Trousdale Ventures, um selo de risco na cadeia de suprimentos poderia ser “fatal” para a Anthropic. Para o DoD, descartar a empresa significaria recorrer a alternativas como OpenAI ou xAI – esta última, de Elon Musk, já se prepara para obter credenciais de confidencialidade e sinaliza disposição para conceder controle total ao governo. Seth estima um intervalo de seis a 12 meses até que outro fornecedor alcance o mesmo nível de desempenho, abrindo uma janela potencial de vulnerabilidade.

Com o prazo se encerrando nesta sexta-feira, permanece a incerteza sobre qual lado cederá primeiro – ou se o Pentágono concretizará a ameaça de rompimento.

Com informações de TechCrunch